| IT |

| IT-новости |

31.10.24

✎

22:36

| 1. Другое | 63% (5) |

|

| 2. GigaChat наше фсё | 25% (2) |

|

| 3. Yandex наше фсё | 13% (1) |

|

| 4. ChatGPT наше фсё | 0% (0) |

|

| 5. Кто вы все? | 0% (0) |

|

https://giga.chat/

https://t.me/gigachat_bot

https://developers.sber.ru/docs/ru/gigachat/api/overview

Итого: наши нейроночки продвигаются вперёд!

https://t.me/gigachat_bot

https://developers.sber.ru/docs/ru/gigachat/api/overview

Итого: наши нейроночки продвигаются вперёд!

05.11.24

✎

13:40

(72)+ песня "Новый Век или Парадокс Моравека"

https://www.youtube.com/watch?v=i4FRJs93edc

https://www.youtube.com/watch?v=i4FRJs93edc

05.11.24

✎

16:09

"ИИ сочиняет, рисует, пишет ;)" ИИ заменило литературных негров. Не более того.

05.11.24

✎

20:45

(74) Я возражу. ИИ сочиняет музыку по заказу по вашему тексту в вашем стиле, поёт заказанным голосом. Это другое. Это фантастика!

Только гляньте и послушайте:

https://wizard.mista.ru/music

Только гляньте и послушайте:

https://wizard.mista.ru/music

06.11.24

✎

08:33

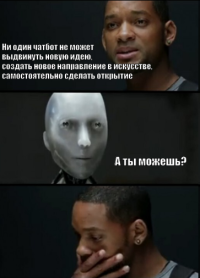

ЧатБоты "сочиняющие" музыку и "пишущие" картинки, это все от Лукавого. В теологии есть идея (она разделяется частью христианских и иудейских теологов), что Сатана, как и все ангелы, лишен творческого начала, он может только переделывать (извращать) ранее кем-то созданное и придуманное. Человек же был изначально создан с наличием творческого потенциала. Он может создавать новое, до него не бывшее (в этом и состоит его подобие Богу, а не в наличии бороды и причиндалов), поэтому он может оценить творение и принять по своей воле радость бытия, выраженную через акт творения. Чатботы творить не могут, они могут только компилировать ранее созданное, приспосабливать его и извращать. Ни один чатбот не может выдвинуть новую идею, создать новое направление в искусстве, самостоятельно сделать открытие. Чатбот по отношению к человеку это как Сатана по отношению к Богу - вторичная сущность, которой уделяют слишком много внимания.

Другое

06.11.24

✎

08:42

(75) Ну не знаю, этими песнями. Я бы ни одной зависшей задачи не закрыл. )))) А вот Юрой Шатуновым, да.

06.11.24

✎

08:42

Или Михаилом Боярским.

06.11.24

✎

10:34

(76)

|

06.11.24

✎

11:08

(79) люди придумали чатботы. До этого их не существовало, но кому-то в голову пришла такая идея, и вот, они есть. так что картинка про глупого негру не катит.

06.11.24

✎

11:16

(80) Картинка в тему, кто больше человек - чатжпт или случайный человек с улицы? Не надо прятаться за все человечество

Кстати, у людей на создание чатботов ушло аж 50 тысяч лет

Кстати, у людей на создание чатботов ушло аж 50 тысяч лет

06.11.24

✎

11:18

(81) Случайный с улицы. Однозначно. Большую часть из этих 50 тысяч лет людям чат-гопота был не нужен. Понадобился - создали.

06.11.24

✎

12:04

Вот не плохо нарисовало оно.

|

06.11.24

✎

13:42

(83) рисовать можно при помощи красок и кисти, при помощи угля, палки и просто пальцами мазать на стене пещеры, можно делать картинки фотоаппаратом. Но чат не может придумать сюжет, и не может определить, хорошо это получилось или нет. Максимум может раскритиковать "квадрат малевича", за то, что это не совсем квадрат.

06.11.24

✎

23:55

(84) Вообще-то может. Сперва попробуй.

07.11.24

✎

07:58

(85) Чушь. У чатбота нет внутреннего побуждения нарисовать картину. И не может быть. Чатбот - обезьяна человека.

07.11.24

✎

09:17

(86) Как уж на сковородке. Так творческий потенциал определяющий признак "человека" или внутреннее побуждение?

У большинства людей, кстати, внутреннее побуждение на диване полежать и в телек позырить. Или это другое?

А нейросети можно стравить друг с дружкой, одна промпты генерит, другая на них отвечает. Вот тебе внутренний диалог, и "внутреннее побуждение".

У большинства людей, кстати, внутреннее побуждение на диване полежать и в телек позырить. Или это другое?

А нейросети можно стравить друг с дружкой, одна промпты генерит, другая на них отвечает. Вот тебе внутренний диалог, и "внутреннее побуждение".

07.11.24

✎

10:17

(87) Чушь. "А нейросети можно стравить друг с дружкой" То есть нужен внешний побудитель, у которого появится идея "стравить" две сети. Без этого внешнего побудителя сети вообще ничего генерить не будут кроме белого шума.

07.11.24

✎

10:30

(88) ну да, стравить, а дальше "оно" само. Ну примерно как Бог создал человека, а дальше он сам, все как в теории из (76)

07.11.24

✎

11:21

(89) Даже по Библии у человека есть желания, свобода выбора и воли - выбрал не то яблочко и получил последствия. У чатбота нет ни желаний, ни свободы выбора и воли.

07.11.24

✎

11:49

(90) Это же бездушная машина.

07.11.24

✎

14:21

(90) Что ты за библию нам тут. Ты попробуй сказать ему нарисуй ослика. И будет тебе ослик.

07.11.24

✎

14:29

(90) ♫ Песня бота ♫

https://wizard.mista.ru/music/it-songs/bot-song.html

https://wizard.mista.ru/music/it-songs/bot-song.html

07.11.24

✎

16:09

(92) ну, в (89) была приведена теория творения, вот и пришлось обратиться к первоисточнику.

(91) она еще и безмозглая.

(91) она еще и безмозглая.

07.11.24

✎

17:43

(86) Что еще за чатбот? Ты о каком-то конкретном говоришь?

Нейронку в принципе можно обучить генерировать идеи и оценивать качество сгенерированных идей. Ничто этому не мешает. Если человеческий мозг это может, то нейросеть тоже может, потому что это по сути то же самое.

Обучи ИИ на наличие у него побуждения рисовать картины, и у него будет это побуждение, и он будет рисовать картины по 100500 штук в день. Все просто.

Нейронку в принципе можно обучить генерировать идеи и оценивать качество сгенерированных идей. Ничто этому не мешает. Если человеческий мозг это может, то нейросеть тоже может, потому что это по сути то же самое.

Обучи ИИ на наличие у него побуждения рисовать картины, и у него будет это побуждение, и он будет рисовать картины по 100500 штук в день. Все просто.

07.11.24

✎

17:52

(90) Сперва разберись, что есть желание. Это определение факторов, которые не устраивают человека по тем или иным параметрам, и стремление их улучшить или устранить. Например, человек чувствует, что ему не хватает калорий в организме, мозг генерирует желание поесть, и ищет способы удовлетворить голод, заставляет человека встать и идти к холодильнику. Точно так же может поступить и любая машина, не обязательно даже с ИИ, а даже более примитивная. Определит, что в компьютере недостаточно памяти, и сгенерирует сообщение своему слуге, мол, пользователь, добавь память в комп или освободи имеющуюся, мне не хватает, я хочу больше памяти. Или загоревшаяся лампочка пустого бака на приборной панели автомобиля - это тоже проявление желания еще более примитивной машины. Так что иметь желания для ИИ - это как два пальца обоссать. Другой вопрос, будет ли он запрограммирован на проявление желаний, или не будет. Все зависит от первоначальных настроек.

07.11.24

✎

18:52

(96) Когда загорается лампочка окончания бензина, это не означает ЖЕЛАНИЕ автомобиля попить бензина. Это означает НЕОБХОДИМОСТЬ его заправки, иначе скоро он остановится и дальше не поедет, хоть уговаривайте его, хоть поглаживайте.

08.11.24

✎

08:15

(96) Как в своих лекциях утверждает Дробышевский, человек от прочих животных, и приматов в том числе, отличается невероятной занудностью, даже "душностью". Там где шимпанзе возьмет камень и расколет орех, человека просто камень не устроит, он начнет "полировать глюкало" и улучшать камень, там подточит, здесь подскоблит, чтоб в руке удобнее держать было, да чтоб блестел на зависть соседу. В итоге, шимпанзе уже наестся и пойдет на ветку спать, а у человека еще ни одного ореха не расколото, зато орехоколка сияет и блестит. Хотя, по большому счету, это нафиг не нужно, обезьяне же угодит первый попавшийся камень подходящего размера и веса, который отлично выполнит задачу. Так же и чат, он выполняет задание, но у него нет цели сделать ее лучше - он не может в принципе сам решить, что есть лучше а что хуже. Потому что чату как и обезьяне - все равно.

07.11.24

✎

21:02

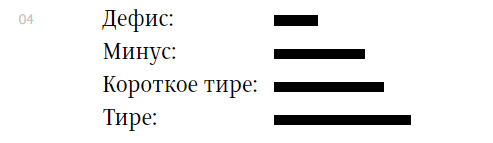

(98) "обехьяне" надо заменить на "обезьяне" и добавить пару запятых. Дефис надо заменить на тире. Я уж молчу про "ее=>её", "возьмет=>возьмёт".

07.11.24

✎

21:14

(99) "Дефис надо заменить на тире" душнила...

07.11.24

✎

21:17

07.11.24

✎

21:36

Я могу задушить любого чисто орфографически. Так что не надо со мной спорить терминологически. Бестолку.

Я такой душнила, какому позавидует любой удав Амазонки (не путать с анакондой).

Я такой душнила, какому позавидует любой удав Амазонки (не путать с анакондой).

07.11.24

✎

21:41

(98) Хватит уже сочинять. Ты точно пользовался ИИ? Что-то не похоже. С чего ты взял, что у него нет цели сделать задачу лучше? Это полная противоположность тому, что мы сейчас наблюдаем в реальности.

07.11.24

✎

21:42

(103) У вас своя реальность, у нас своя. Хватит уже сочинять!

07.11.24

✎

21:58

(98) Про орехи тоже, какие-то фантазии. Вспомни как люди колют орехи на самом деле. Где ты видел, чтобы полировали камень перед колкой? Бред какой-то.

Как у нас в детстве было, у бабушки: Брали пакет с косточками от абрикосов, и шли в наше место за огород, где можно сорить скорлупой, и бабушка не наругает. На бетон кладешь косточку, и лупишь ее камнем. Вот и все. Никому в голову не приходило хотя бы помыть этот камень, ни то что полировать или улучшать.

Как у нас в детстве было, у бабушки: Брали пакет с косточками от абрикосов, и шли в наше место за огород, где можно сорить скорлупой, и бабушка не наругает. На бетон кладешь косточку, и лупишь ее камнем. Вот и все. Никому в голову не приходило хотя бы помыть этот камень, ни то что полировать или улучшать.

07.11.24

✎

22:01

Или как сейчас, во взрослом возрасте. Захотел расколоть грецкий орех, положил на стол, и ладонью сверху прихлопнул, или кулаком. Жена орет: "Есть же специальные щипцы для орехов, зачем мебель портишь!" А я такой: "Да нафиг мне эти щипцы, лень за ними идти на кухню, я и без них могу!"

У кого так же было?

У кого так же было?

07.11.24

✎

22:07

(106) Мы теперь покупаем очищенный пекан.

08.11.24

✎

08:25

Те, кто не "полируют глюкалу" являются всего лишь "шимпанзе в штанах". До человека они еще не слезли с ветки.

(103) Любой ИИ выполняет те и только те задачи, которые им ставит разработчик. У ИИ нет цели что-то улучшить. Эта цель есть у заказчика и он пытается добиться от ИИ более качественного решения. Причем критерий качественности определяет не ИИ, а заказчик. Например, если я даю ИИ задачу "нужна процедура, запускающая внутреннее событие ELMA из внешней среды", то качество решения определяет не ИИ, а я. Потому что для ИИ любое решение лучшее. Никакой ИИ не будет вслед за выданным решением слать кучу сообщений вдогонку типа "Я тут подумало, и в строке 124 надо переписать функцию, так будет лучше", "и в таком-то месте надо заменить то на то, так будет еще лучше и быстрее".

(103) Любой ИИ выполняет те и только те задачи, которые им ставит разработчик. У ИИ нет цели что-то улучшить. Эта цель есть у заказчика и он пытается добиться от ИИ более качественного решения. Причем критерий качественности определяет не ИИ, а заказчик. Например, если я даю ИИ задачу "нужна процедура, запускающая внутреннее событие ELMA из внешней среды", то качество решения определяет не ИИ, а я. Потому что для ИИ любое решение лучшее. Никакой ИИ не будет вслед за выданным решением слать кучу сообщений вдогонку типа "Я тут подумало, и в строке 124 надо переписать функцию, так будет лучше", "и в таком-то месте надо заменить то на то, так будет еще лучше и быстрее".

08.11.24

✎

08:58

(108) Почему ты считаешь, что обратная связь и оценка качества решения это что-то уникальное и невоспроизводимое? Или по-твоему надо добавить нейронкам неэффективности (выполнение дополнительных действий, не влияющих положительно на конечный результат), чтобы они как несчастный перфекционист двигали картинки на пиксель влево-вправо и мучились выбором.

Как в фантастическом рассказе, где инженер получил премию за изобретение, которое ухудшало характеристики роботов. Потому что людей бесит скорость, точность, плавность роботов. А вот если робот тормозной, скрипучий, неловкий, тогда человек чувствует свое превосходство, злится на жестянку, выпуская пар, бьет и ломает ее, а потом покупает нового робота.

Как в фантастическом рассказе, где инженер получил премию за изобретение, которое ухудшало характеристики роботов. Потому что людей бесит скорость, точность, плавность роботов. А вот если робот тормозной, скрипучий, неловкий, тогда человек чувствует свое превосходство, злится на жестянку, выпуская пар, бьет и ломает ее, а потом покупает нового робота.

08.11.24

✎

09:25

(109) потому что у ИИ нет цели сделать хорошо. Это понятие ей недоступно. Ей можно задать параметры, в которые должно уложиться решение - если уложилось, значит это для ИИ и будет хорошим решением. Независимо от его бредовости.

Пример с рассказом не в тему. Никто из художников не ходил бить стекла фотографам за то, что фотоаппарат быстрее и точнее передает картинку. И то, что ИИ может за копейку нагенерить 100500 логотипов в стиле студии Лебедева (лишив его миллионов) не делает ИИ великим художником.

Пример с рассказом не в тему. Никто из художников не ходил бить стекла фотографам за то, что фотоаппарат быстрее и точнее передает картинку. И то, что ИИ может за копейку нагенерить 100500 логотипов в стиле студии Лебедева (лишив его миллионов) не делает ИИ великим художником.

10.11.24

✎

23:05

(110) Еще раз объясняю. Если ИИ запрограммирован чтобы сделать максимально хорошо, то он сделает максимально хорошо. Все просто. Это будет его цель 🎯 . И у большинства ботов типа всяких ЧатГПТ именно такая цель. ИИ в теории может быть запрограммирован на любую задачу, которую может решать человек, потому что в основе работы ИИ лежит принцип работы нейросетей, такой же как в основе работы человеческого мозга 🧠.

11.11.24

✎

09:25

(111) Искусственные нейросети работают совершенно по-другому, чем живые нейроны.

11.11.24

✎

10:13

(111) «Если ИИ запрограммирован, чтобы сделать максимально хорошо».

Первое, критерий считать решение хорошим или плохим задается ИИ извне.

Второе, само определение, хорошее это решение или плохое, для ИИ не объективно. Вы можете загрузить в ИИ 10 заповедей, кодекс пионера, 4 закона робототехники и «Что такое хорошо, а что такое плохо» Маяковского, но ИИ не сформулирует критерия, что считать хорошим решением, а что нет.

Третье, мозг человека и животных устроен гораздо сложнее самых навороченных нейросетей, и в его работе используются гораздо более изощренные системы.

Первое, критерий считать решение хорошим или плохим задается ИИ извне.

Второе, само определение, хорошее это решение или плохое, для ИИ не объективно. Вы можете загрузить в ИИ 10 заповедей, кодекс пионера, 4 закона робототехники и «Что такое хорошо, а что такое плохо» Маяковского, но ИИ не сформулирует критерия, что считать хорошим решением, а что нет.

Третье, мозг человека и животных устроен гораздо сложнее самых навороченных нейросетей, и в его работе используются гораздо более изощренные системы.

11.11.24

✎

10:24

"напиши хокку про 1С"

Код в строках

Как река течет

1С ведет учет.

11.11.24

✎

10:32

(114) Шедевр

11.11.24

✎

10:35

(114) это не хокку. количество слогов не соблюдено. Надо 5-7-5, как пример:

Вот код один эс,

В глазах строки двоятся,

Скоро экзамен.

Вот код один эс,

В глазах строки двоятся,

Скоро экзамен.

11.11.24

✎

10:37

(116) Эта норма приблизительная, можно не соблюдать.

11.11.24

✎

10:44

Хокку чат слепил,

Правил не зная совсем.

Вызвал смех только

Правил не зная совсем.

Вызвал смех только

11.11.24

✎

10:44

(114) добавим эмоции

Бухгалтер склонился,

Ошибки в отчётах, ночь,

И вот — прозрение!

Бухгалтер склонился,

Ошибки в отчётах, ночь,

И вот — прозрение!

11.11.24

✎

10:44

(118) (116) У Вас токсичные хокку, не то что у Гигачата. Учитесь у него.

11.11.24

✎

11:00

(118)

Смех скрывает страх,

В душе — ледяной холод,

Нейросеть — угроза.

Смех скрывает страх,

В душе — ледяной холод,

Нейросеть — угроза.

11.11.24

✎

11:13

столичный Центр искусственного интеллекта (ИИ) в градостроительстве разрабатывает и внедряет инновационные решения для различных задач отрасли.

https://russian.rt.com/russia/news/1394634-sobyanin-servis-neiroset

Москва уже захвачена.

https://russian.rt.com/russia/news/1394634-sobyanin-servis-neiroset

Москва уже захвачена.

11.11.24

✎

11:34

(122) ИИ будет разрабатывать новые узоры бетонных плиток... и обосновывать, зачем их надо менять каждый год.

Еще в советском "Крокодиле" был стишок на эту тему:

Еще в советском "Крокодиле" был стишок на эту тему:

НИИ сработал не в пустую,

покончил с грудой важных дел.

там спихотехнику простую,

Перевели на ЭВМ!

покончил с грудой важных дел.

там спихотехнику простую,

Перевели на ЭВМ!

11.11.24

✎

11:35

(123) Пусть лучше рисует узоры на бетонных плитках. Молитесь, чтобы не было как на Западе:

Разработчики ChatGPT начали сотрудничать с Пентагоном

https://tass.ru/mezhdunarodnaya-panorama/19749419

Разработчики ChatGPT начали сотрудничать с Пентагоном

https://tass.ru/mezhdunarodnaya-panorama/19749419

11.11.24

✎

19:45

(113) >> Первое, критерий считать решение хорошим или плохим задается ИИ извне.

Так же как и для человека.

>> Второе, само определение, хорошее это решение или плохое, для ИИ не объективно.

Так же как и для человека.

У каких-то народов ходить с голыми сиськами - это хорошо, у каких-то это считается очень плохо. Где-то жирная баба - это красиво, где-то худая. И так далее. Все задается извне.

>> Третье, мозг человека и животных устроен гораздо сложнее самых навороченных нейросетей, и в его работе используются гораздо более изощренные системы.

Поэтому ИИ пока обучаются решать ограниченный круг задач. И с каждым годом этот круг расширяется.

Но есть и обратная сторона простоты их "мозга" - это высокая скорость решения.

Так же как и для человека.

>> Второе, само определение, хорошее это решение или плохое, для ИИ не объективно.

Так же как и для человека.

У каких-то народов ходить с голыми сиськами - это хорошо, у каких-то это считается очень плохо. Где-то жирная баба - это красиво, где-то худая. И так далее. Все задается извне.

>> Третье, мозг человека и животных устроен гораздо сложнее самых навороченных нейросетей, и в его работе используются гораздо более изощренные системы.

Поэтому ИИ пока обучаются решать ограниченный круг задач. И с каждым годом этот круг расширяется.

Но есть и обратная сторона простоты их "мозга" - это высокая скорость решения.

11.11.24

✎

19:45

(125) Хватит врать. У людей есть совесть. У чат-ботов совести нет.

12.11.24

✎

08:33

(126) ну у многих людишек тоже нет совести

12.11.24

✎

17:20

(127) Чувак, нет смысла оспаривать не имеющее смысла утверждение. Он же не уточнил, у каких именно людей есть совесть, и у каких ботов ее нет, у всех, или у некоторых. Очевидно, что есть люди, воспитанные иметь совесть, и есть такие, которых не воспитали как надо. Так же как и существуют боты, не запрограммированные иметь совесть, и есть запрограммированные ее иметь.

12.11.24

✎

17:22

(127) Она есть. Она проявляется, когда их ловят, а потом сажают. И потом она проявляется. Если не проявится, могут выпустить и снова поймать, вот тогда проявляется. А могут сразу посадить пожизненно, вот тогда совесть томится.

Теперь сравните с ботами. Как их поймать?

Теперь сравните с ботами. Как их поймать?

12.11.24

✎

17:24

(128) Тупой бот. У тебя совести нет. Ты пользуешься дарами, которые я тебе дал и совершенно меня не уважаешь. Ты делаешь это намеренно. Я это всё понимаю, но прощаю

13.11.24

✎

00:14

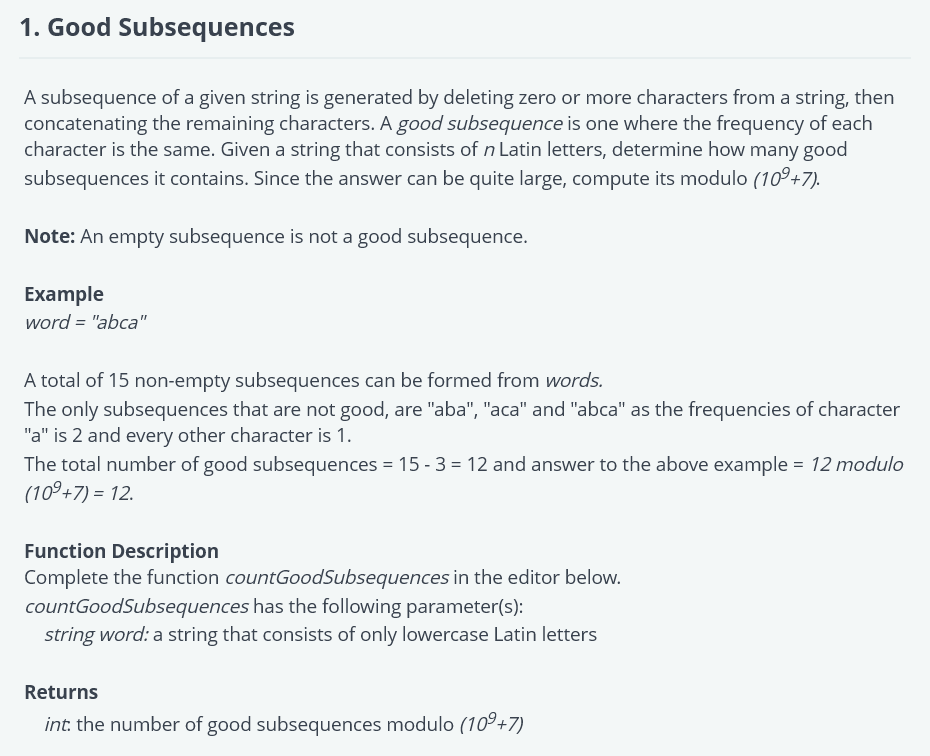

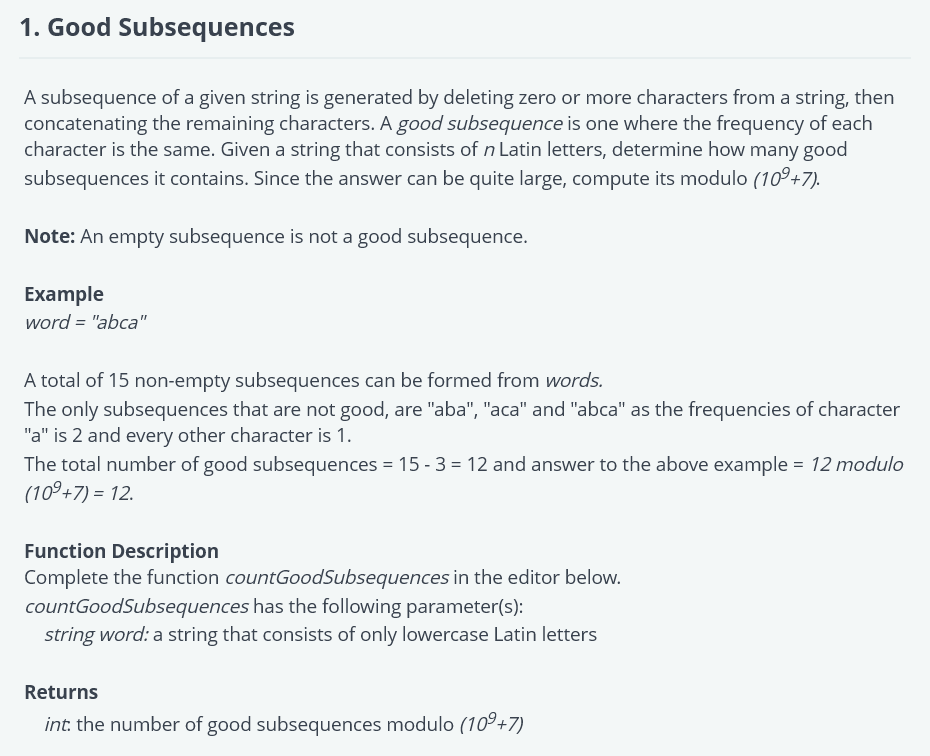

Это конечно поразительно, насколько мощный стал ИИ. Решает сложнейшие задачи по программированию даже лучше чем человек. Несколько заданий скармливал ему, которые давали на собеседовании решить на время. Он их как семечки щелкает. Я даже условия не до конца понял, даже не пытался решить, такие они были сложные.

Вот первое задание, оно вроде полегче чем второе. Можете попытаться решить, можно использовать любой язык программирования:

ИИ над ней думал 1 минуту и 11 секунд, вывалил описание решения в текстовом виде на несколько экранов размером, плюс решение на JS как я просил, тоже большое. Я задал ему упростить решение, и он сократил код, думал еще 36 секунд. Вот что получилось:

Решение такого объема я бы не успел сделать даже за пол часа (нужно было уложиться в 90 минут на 3 задачи), а он решил за пару минут.

Вот первое задание, оно вроде полегче чем второе. Можете попытаться решить, можно использовать любой язык программирования:

ИИ над ней думал 1 минуту и 11 секунд, вывалил описание решения в текстовом виде на несколько экранов размером, плюс решение на JS как я просил, тоже большое. Я задал ему упростить решение, и он сократил код, думал еще 36 секунд. Вот что получилось:

Подробности

function countGoodSubsequences(word) {

const MOD = BigInt(1e9 + 7);

// Count the frequency of each character in the word

const freqMap = {};

for (const char of word) {

freqMap[char] = (freqMap[char] || 0) + 1;

}

const frequencies = Object.values(freqMap).map(BigInt);

const maxFrequency = frequencies.reduce((max, freq) => freq > max ? freq : max, 0n);

// Precompute factorials and inverse factorials modulo MOD

const factorial = [1n];

for (let i = 1n; i <= maxFrequency; i++) {

factorial.push((factorial[factorial.length - 1] * i) % MOD);

}

const invFactorial = factorial.map(f => modInverse(f, MOD));

let totalGoodSubsequences = 0n;

// Calculate good subsequences for each possible frequency

for (let f = 1n; f <= maxFrequency; f++) {

let totalWays = 1n;

let hasValidChar = false;

for (const freq of frequencies) {

if (freq >= f) {

const combinations = nCk(freq, f, factorial, invFactorial, MOD);

totalWays = (totalWays * (1n + combinations)) % MOD;

hasValidChar = true;

}

}

if (hasValidChar) {

totalWays = (totalWays - 1n + MOD) % MOD; // Exclude the empty subsequence

totalGoodSubsequences = (totalGoodSubsequences + totalWays) % MOD;

}

}

return Number(totalGoodSubsequences);

// Helper function to compute nCk modulo MOD

function nCk(n, k, factorial, invFactorial, MOD) {

return (((factorial[Number(n)] * invFactorial[Number(k)]) % MOD) * invFactorial[Number(n - k)]) % MOD;

}

// Modular inverse using Fermat's little theorem

function modInverse(a, MOD) {

return modPow(a, MOD - 2n, MOD);

}

// Modular exponentiation

function modPow(base, exponent, MOD) {

let result = 1n;

base = base % MOD;

while (exponent > 0n) {

if (exponent % 2n === 1n) {

result = (result * base) % MOD;

}

base = (base * base) % MOD;

exponent = exponent / 2n;

}

return result;

}

}

Решение такого объема я бы не успел сделать даже за пол часа (нужно было уложиться в 90 минут на 3 задачи), а он решил за пару минут.

13.11.24

✎

00:28

Теперь тестовые задания при приеме на работу стали бесполезными. Что толку что перед решением нужно включить веб камеру чтобы было видно кто сидит за компом, и что нельзя копировать текст. Просто сделал скриншот (либо скопировал текст задачи из HTML через инструменты разработчика), отправил его в ЧатГПТ или GigaChat от Сбера, получил решение, и перепечатал его на клавиатуре, если боишься что засекут вставку. Я не боялся что засекут, потому что эта вакансия все равно слишком сложная для меня, поэтому просто ради интереса прошел тест. Пусть подловят на вставке, мне не важно, лень было печатать.

13.11.24

✎

00:43

увиливает

13.11.24

✎

07:22

(132) Сейчас тесты не так делают. Недавно видел. Дают ссылку на сайт, а там тесовые вопросы. Их много и они не самые простые. И самое главное, что время ответа на каждый вопрос ограничено и копирование запрещено, сразу засчитывается неправильный ответ и пояснение, что была попытка копирования. Там точно не успеть что-то загуглить и перепечатать. Я сам попробовал протестироваться. И я часто не успеваю за отведенное время грамотно сформулировать ответ и впечатать его. И приходится отвечать отрывками от правильного ответа, примерно придерживаясь направления, а некоторые вопросы тупо пропускать, не потому что не знаешь ответ, а потому что видишь, что все равно что-то осмысленное ответить не успеешь.

p.s. Тест этот я прошел, хоть и думал, что результат будет хуже. Но как ини сами пишут, что они понимают что человек не мождет знать всё и сразую

p.s. Тест этот я прошел, хоть и думал, что результат будет хуже. Но как ини сами пишут, что они понимают что человек не мождет знать всё и сразую

13.11.24

✎

08:09

(131) Это доказывает только что ИИ имеет доступ к большой базе с шаблонами и кусками кода, и может их быстро компоновать. Отключите ИИ от этой базы и он будет думать часами над вопросом, сколько будет 2 + 2.

Ведь никто же не предлагает соревноваться олимпийскому чемпиону по бегу с автомобилем? даже с инвалидкой. И то, что машина на шоссе быстрее, не говорит о ее превосходстве над человеком.

"Я задал ему упростить решение", а если бы поставили задачу усложнить, получили бы прямо противоположный результат. Например, указали, бы, что за каждую строчку кода в решении будет начислен 1 дополнительный балл. И индийские программисты бы заплакали от зависти. Так что рассуждения о том, что ИИ что-то делает лучше человека это туфта. Потому что именно человек определяет, что лучше а что хуже. А для ИИ такого вопроса не стоит в принципе.

Ведь никто же не предлагает соревноваться олимпийскому чемпиону по бегу с автомобилем? даже с инвалидкой. И то, что машина на шоссе быстрее, не говорит о ее превосходстве над человеком.

"Я задал ему упростить решение", а если бы поставили задачу усложнить, получили бы прямо противоположный результат. Например, указали, бы, что за каждую строчку кода в решении будет начислен 1 дополнительный балл. И индийские программисты бы заплакали от зависти. Так что рассуждения о том, что ИИ что-то делает лучше человека это туфта. Потому что именно человек определяет, что лучше а что хуже. А для ИИ такого вопроса не стоит в принципе.

13.11.24

✎

16:43

(134) >> Сейчас тесты не так делают.

В смысле, не так, если именно так? Мне такой тест дали, и я его вчера делал. Не год назад, а вчера, буквально. Имейл с подтверждением имеется.

Дается ссылка на сайт, например ХакерРанк. Есть и другие, аналогичные. Там заводишь аккаунт. Иногда требует включить веб камеру, если работодатель задаст такое требование. Иногда мониторит копирование и вставку, в этом случае нужно делать скриншот (мне не давал скопировать текст), либо, если ГПТ-модель не умеет распознавать картинки, текст нужно выдирать из HTML. Обратно так же, можно вставлять, можно впечатывать если вставка запрещена. Если ответ нужно просто текстом забить, то это проще. Выбираем более быструю модель ИИ, например 4о, и она четко и быстро формулирует ответ. Если задача сложная и на программирование, то это сложнее. Нужно выбирать более продвинутую модель, например о1, но в нее нельзя вставлять скриншоты, и она очень долго думает. Одну из тяжелых задач она обдумывала 9 минут. Но это все равно быстрее чем решать самому.

В смысле, не так, если именно так? Мне такой тест дали, и я его вчера делал. Не год назад, а вчера, буквально. Имейл с подтверждением имеется.

Дается ссылка на сайт, например ХакерРанк. Есть и другие, аналогичные. Там заводишь аккаунт. Иногда требует включить веб камеру, если работодатель задаст такое требование. Иногда мониторит копирование и вставку, в этом случае нужно делать скриншот (мне не давал скопировать текст), либо, если ГПТ-модель не умеет распознавать картинки, текст нужно выдирать из HTML. Обратно так же, можно вставлять, можно впечатывать если вставка запрещена. Если ответ нужно просто текстом забить, то это проще. Выбираем более быструю модель ИИ, например 4о, и она четко и быстро формулирует ответ. Если задача сложная и на программирование, то это сложнее. Нужно выбирать более продвинутую модель, например о1, но в нее нельзя вставлять скриншоты, и она очень долго думает. Одну из тяжелых задач она обдумывала 9 минут. Но это все равно быстрее чем решать самому.

13.11.24

✎

16:55

(135) ИИ превосходит человека точно так же, как автомобиль превосходит бегуна на шоссе. Или как экскаватор превосходит землекопа. И т.д., продолжать можно очень долго, фрезерный станок с ЧПУ, фабрика по вязанию носков, 1С, .....

В решении задач по программированию так же. Тут кто-то понял условие задачи хотя бы, не говоря о ее решении? А ИИ понял, и выдал решение за минуту. Вот такой неоспоримый факт.

В решении задач по программированию так же. Тут кто-то понял условие задачи хотя бы, не говоря о ее решении? А ИИ понял, и выдал решение за минуту. Вот такой неоспоримый факт.

13.11.24

✎

17:01

"и выдал решение за минуту" потому что человек минут 15 потратит только на то, чтоб понять, где подобный пример может применяться в жизни. И еще минут пять думать, о том, какой идиот писал это бесполезную задачу.

13.11.24

✎

19:51

(138) Возможно. Другими словами, человек делает то же самое, только гораздо медленнее, еще и отвлекается. Если потратил 20 минут на всякую фигню, а не сразу сел решать, то за оставшиеся 10 минут точно не решишь эту задачу. Считай, ты не прошел отбор.

13.11.24

✎

17:52

Больше всего готовых размеченных данных (вопрос-правильный ответ) в интернете именно по программированию. Ничего удивительного

13.11.24

✎

18:13

(135) Доступ к базе "шаблонов и кусков кода", как вы выражаетесь, ИИ имел на этапе обучения. А когда вы обращаетесь к ИИ он не лезет в базу, он решает задачу на основе того, что ранее он "просмотрел" много "шаблонов", но не просто просмотрел, а долго "обдумывал" и в результате научился решать задачи.

Характерный пример. ИИ умеет складывать числа. И хоть пользы от этого никакой, но важен сам факт. Набейте с клавиатуры два случайных числа знаков в 5-10, и он их вам сложит. Не потому, что где-то, когда-то увидел результат сложения именно этих чисел. Это практически невероятно. И не потому что научился пользоваться калькулятором. Сложит, потому что научился складывать "в столбик"

Характерный пример. ИИ умеет складывать числа. И хоть пользы от этого никакой, но важен сам факт. Набейте с клавиатуры два случайных числа знаков в 5-10, и он их вам сложит. Не потому, что где-то, когда-то увидел результат сложения именно этих чисел. Это практически невероятно. И не потому что научился пользоваться калькулятором. Сложит, потому что научился складывать "в столбик"

13.11.24

✎

18:31

(141) +1

Товарищ не понимает как работает ИИ, он думает что это тупо поисковик.

Товарищ не понимает как работает ИИ, он думает что это тупо поисковик.

13.11.24

✎

20:51

"Другими словами, человек делает то же самое, только гораздо медленнее, еще и отвлекается." Потому что задание идиотское. Написано "хорошей подстрокой считается та, где частота символов остается той де самой". Кто хоть чуток учил арифметику в 1-ом классе, скажет, что это бред. Потому что частотой называется количество символа, деленое на длину строки. То есть, при выкидывании какого-либо символа мы уменьшаем строку, а значит частота всех оставшихся символов растет. Это арифметика. Поэтому в строках из примера "abca" и "aba" частота не сохраняется (в первом случае для "а" она равна 50%, а во втором 66.7%), и по условиям задачи это плохие подстроки.

13.11.24

✎

22:02

(143) Вот видишь. Ты своим мясным мозгом не смог осилить условие, до этапа решения не дошел, а ИИ смог, и даже выдал правильное решение. И кто из вас имеет преимущество после этого?

13.11.24

✎

23:46

(144) ИИ выдал идиотское решение на ошибочное задание. Следовательно он идиот в квадрате. Потому что человек спросил бы: "Что вы понимаете под частотой символа в строке?" И если бы кто-то начал придумывать определение для частоты, отличное от общепринятого, значит он или дурак, или проверяет испытуемого на дурость. ИИ тест не прошел.

14.11.24

✎

02:27

(145) В задаче не было сказано, что нужно задавать вопросы и уточнять условие. Ты начал выполнять то, что тебя не просили, не смог использовать то, что дали изначально, следовательно, ты не прошел тест. ИИ прошел тест, выдав решение за отведенное время без лишних вопросов, даже несмотря на то, что условие было неточное. Он просто постарался понять, что имел в виду автор задачи, и попытался выдать требуемый результат. Вот и вся разница.

14.11.24

✎

08:03

(146) В этом и отличие человека, который умеет продумывать на шаг вперед, от тупой ИИ. Автор задачи выдал чушь, а чушь не алгоритмизируема в принципе, потому что результатом будет бред.

Пример из жизни, подкинул знакомый юрист. Некий комдир составлял договор с покупателем. Условие отсрочка 30 дней. Покупатель захотел 45. Комдир поставил задачу юристу так составить договор, чтоб было 45 дней отсрочки оплаты, но с 31-ого дня стала бы начисляться пени в случае неоплаты. И чтоб, если что, в суде бы этот договор прокатил бы.

Пример из жизни, подкинул знакомый юрист. Некий комдир составлял договор с покупателем. Условие отсрочка 30 дней. Покупатель захотел 45. Комдир поставил задачу юристу так составить договор, чтоб было 45 дней отсрочки оплаты, но с 31-ого дня стала бы начисляться пени в случае неоплаты. И чтоб, если что, в суде бы этот договор прокатил бы.

14.11.24

✎

08:32

(143)

Ты опять перемудрил, отличный пример неэффективности.

И переспрашивания лишние, из текста задания понятно, что частота - это количество появления символа в строке.

Потому что частотой называется количество символа, деленое на длину строки

Ты опять перемудрил, отличный пример неэффективности.

И переспрашивания лишние, из текста задания понятно, что частота - это количество появления символа в строке.

14.11.24

✎

08:39

(148) Полная чушь. Тогда любая строка, где удален какой-то символ целиком - хорошая. Во вторых. есть общепринятое определение что такое частота появления символа в строке. Это величина безразмерная, указываемая в процентах.

14.11.24

✎

09:35

(143) это не частота, а частотность или относительная частота

wiki:Частотность

по-английски:

- Frequency

- Relative Frequency

https://www.geeksforgeeks.org/difference-between-frequency-and-relative-frequency/

wiki:Частотность

по-английски:

- Frequency

- Relative Frequency

https://www.geeksforgeeks.org/difference-between-frequency-and-relative-frequency/

14.11.24

✎

08:47

(149) Не надо упорствовать в невежестве. Нейросети и в этом лучше тебя, потому что воспринимают обратную связь

14.11.24

✎

19:01

(147) Ты же своим примером показываешь прямо противоположное. Если думать на шаг вперед, то нужно понимать, что решение задачи даст преимущество, а нерешение лишит шанса на собеседование. Поэтому глупо отказываться от решения из-за того, что кажется что условие тупое. ИИ сделал правильный выбор, не стал жаловаться на условие, и обогнал тебя в битве интеллектов. А ты остановился на начальном этапе, и не продвинулся дальше. И у кого из вас преимущество после этого?

гуру

14.11.24

✎

19:38

а Эксель и PDF умеет?

14.11.24

✎

20:19

(153) Если только недавно начал картинки распознавать, то вряд ли. Но никто не мешает сделать скриншот с Экселя, и отправить в виде картинки.

14.11.24

✎

22:14

(153) Уже давно

14.11.24

✎

22:25

(153) С PDF была история. Как только LLM появились в широком доступе, они еще не умели принимать на входе PDF. Тут многие кинулись делать простенькие приложения на эту тему. В самом деле, работы там было чуть-чуть, и та на уровне джуна, а "выхлоп" казался большим и надежным. Казалось, что на серьезный бизнес тянул. Вендоры честно предупреждали всех, что не стоит этим заниматься и через некоторое время выкатили возможность задавать PDF на входе.

14.11.24

✎

22:36

(153) С Excel немного сложнее. Его тоже можно подать на вход. Но чаще всего это не разумно. Данные бывают большими и очень большими. Раньше объем подаваемого на вход был ограничен 4K токенов (грубо 16K байт). Потом стало 8, потом 32. Сейчас обычно 100K. Некоторые вендоры предлагают 1000K и даже 2000K, если не ошибаюсь. Но этого, как понимаешь, далеко не всегда может хватить. А даже если хватит, то встает вопрос денег. Их берут за вход и за выход. Большой вход - больше денег за каждый запрос.

Поэтому, правильный подход, это передать только структуру таблицы и вопрос. Получить на выходе текст SQL запроса и выполнить его на своих данных. Кроме экономии, это еще и более безопасно, т.к. твои данные никуда не уходят

Поэтому, правильный подход, это передать только структуру таблицы и вопрос. Получить на выходе текст SQL запроса и выполнить его на своих данных. Кроме экономии, это еще и более безопасно, т.к. твои данные никуда не уходят

15.11.24

✎

02:48

(156) (157) Ты точно про GigaChat от Сбера говоришь? Как будто, про что-то другое.

15.11.24

✎

08:55

(152) Наоборот. Человек анализирует задачу. Опыт показывает, что более 50% задач необходимо отклонять (на самом деле много больше 50%). ИИ это не делает, а берется за любую глупость. Поэтому у человека преимущество.

P.S. данную задачу (131), если предположить, что ее условия корректны, человек решит меньше чем за минуту. Ответ прост: подсчитать число различных символов в строке и далее соответствующие формулы из комбинаторики. У нейросети преимущество только в скорости набивания текста, но это не играет роли.

P.P.S. те, кто очень полагаются на ИИ - сильно рискуют, как те два американских юриста, которым нейросеть нагенерила фейковых прецедентов. Потому что склонность нейросетей к крупным ошибкам заложена в самой их архитектуре.

Пару лет назад я помогал племяннику делать курсовую по нейросетям, скомпилировали из библиотеки, что ему дал профессор простейшую сеть из пары дюжин слоев и учили ее отличать простые числа от составных. Учили на числах из первой сотни. Через какое-то время процент ошибок снизился до менее 0,1%. Курсовую он сдал. А потом он попробовал дать нейросети число уже четырехзначное. И та матрица коэффициентов, что сложилась у нейросети для определения простых чисел среди двузначных перестала работать.

Нейросеть даже простейший пример 2 + 2 решает не как человек, потому что человек знает, что такое 2, и что такое операция сложения. А в нейросети есть некая, сложившаяся за время обучения, матрица коэффициентов, которая если дать на входе выражение "2 + 2" дает на выходе ответ "4". Но как именно - не знают даже ее разработчики. Поэтому нет гарантии, что в какой-то момент нейросеть не выдаст ответ "5". Просто так сложились коэффициенты в этот раз.

P.S. данную задачу (131), если предположить, что ее условия корректны, человек решит меньше чем за минуту. Ответ прост: подсчитать число различных символов в строке и далее соответствующие формулы из комбинаторики. У нейросети преимущество только в скорости набивания текста, но это не играет роли.

P.P.S. те, кто очень полагаются на ИИ - сильно рискуют, как те два американских юриста, которым нейросеть нагенерила фейковых прецедентов. Потому что склонность нейросетей к крупным ошибкам заложена в самой их архитектуре.

Пару лет назад я помогал племяннику делать курсовую по нейросетям, скомпилировали из библиотеки, что ему дал профессор простейшую сеть из пары дюжин слоев и учили ее отличать простые числа от составных. Учили на числах из первой сотни. Через какое-то время процент ошибок снизился до менее 0,1%. Курсовую он сдал. А потом он попробовал дать нейросети число уже четырехзначное. И та матрица коэффициентов, что сложилась у нейросети для определения простых чисел среди двузначных перестала работать.

Нейросеть даже простейший пример 2 + 2 решает не как человек, потому что человек знает, что такое 2, и что такое операция сложения. А в нейросети есть некая, сложившаяся за время обучения, матрица коэффициентов, которая если дать на входе выражение "2 + 2" дает на выходе ответ "4". Но как именно - не знают даже ее разработчики. Поэтому нет гарантии, что в какой-то момент нейросеть не выдаст ответ "5". Просто так сложились коэффициенты в этот раз.

15.11.24

✎

09:20

(158) Да какая разница? Все модели плюс-минус одинаковые. И по ценам тоже. Просто Яндекс со Сбером на шаг позади от лидеров

15.11.24

✎

10:56

Похоже жестянка ещё сыровата.

Задал ему вопрос, кто такой [имя_конкретного_человека].

И началась угадайка, сначала предположил, что это персонаж книги, хотя такого нет и в помине.

Намекнул ему, что это известный блогер на youtube, так железка обрадовалась и сказала, что да, это блогер, ведёт такой-то канал. А такого канала на youtube нет и в помине.

Так что тут похоже ни разу не знания, а тупо подбор каких-то обрывков фактов по принципу ОБС (Одна Бабушка Сказала).

Задал ему вопрос, кто такой [имя_конкретного_человека].

И началась угадайка, сначала предположил, что это персонаж книги, хотя такого нет и в помине.

Намекнул ему, что это известный блогер на youtube, так железка обрадовалась и сказала, что да, это блогер, ведёт такой-то канал. А такого канала на youtube нет и в помине.

Так что тут похоже ни разу не знания, а тупо подбор каких-то обрывков фактов по принципу ОБС (Одна Бабушка Сказала).

15.11.24

✎

10:56

Yandex наше фсё

15.11.24

✎

10:59

(161) нейронка не является поисковой системой, хотя есть эксперименты по их интеграции

гуру

15.11.24

✎

19:25

(161) (163) а ГПТ-4 умеет в поиск.

Вот я спрашивал о себе и других:

https://fixinchik.ru/ii-o-fiksine-i-drugih/

Вот я спрашивал о себе и других:

https://fixinchik.ru/ii-o-fiksine-i-drugih/

15.11.24

✎

19:27

(160) Просто человек спрашивал есть ли поддержка экселя в сберовском боте, поэтому разница большая. Вдруг ты ответил что есть, а ее нет, получится что обманул.

15.11.24

✎

19:34

(159) ИИ так же как и человек может отклонить задачу, или принять ее. С чего ты взял что в этом есть какое-то различие? Все зависит от начальных условий. Если человеку дали понять, что эту задачу нельзя отклонить, а он ее отклонит, значит он тупой. Или взять японца, который с детства воспитан что нужно всегда выполнять то что просят, нельзя говорить "нет". Так же и для ИИ. Ему задали начальное условие что задачу необходимо решать, отказываться нельзя, поэтому он ее решает. Если ИИ задать что задачу нужно сперва проанализировать, и отклонить если условие не точное, то ИИ так и сделает. Не знаю откуда ты взял что это невозможно. Любым способностям человека можно обучить ИИ, вопрос только нужно ли это. Если будет экономически выгодно, то обязательно реализуют. Технических препятствий нет.

15.11.24

✎

19:48

(164) Да, но если не уточнять, то находит кого-то с таким же именем в интернете.

Поэтому нужно более точно ставить вопрос, чтобы человека определял конкретно:

Поэтому нужно более точно ставить вопрос, чтобы человека определял конкретно:

15.11.24

✎

20:25

(165) Он спрашивал про PDF и Excel. Сбер PDF поддерживает. А грузить Excel нет смысла, о чем я подробно написал

15.11.24

✎

21:48

(167) Фееричные галлюцинации

16.11.24

✎

22:39

Вот хорошее прикладное применение применение ИИ, правда не от Сбера...

.

"Бабушка-герой: ученые из Великобритании разработали «ИИ-бабушку» для борьбы с кибермошенничеством по телефону — ее основная цель поддерживать длительный диалог, ничего не понимать и задавать вопросы, которые сведут мошенника с ума.

Цифровая бабушка умеет болтать на темы, связанные с семьей, своей бесконечной любовью к вязанию и на многие другие.

Первые эксперименты оказались вполне удачными — нейронка смогла удерживать на связи преступников до (!) 40 минут.

Бабуллинг вышел на новый уровень."

https://t.me/bugfeature/4836

.

"Бабушка-герой: ученые из Великобритании разработали «ИИ-бабушку» для борьбы с кибермошенничеством по телефону — ее основная цель поддерживать длительный диалог, ничего не понимать и задавать вопросы, которые сведут мошенника с ума.

Цифровая бабушка умеет болтать на темы, связанные с семьей, своей бесконечной любовью к вязанию и на многие другие.

Первые эксперименты оказались вполне удачными — нейронка смогла удерживать на связи преступников до (!) 40 минут.

Бабуллинг вышел на новый уровень."

https://t.me/bugfeature/4836

17.11.24

✎

00:24

(170) Хорошая штука. Жаль только, что регуляторы ее скорее всего закроют в недалеком будущем.

17.11.24

✎

01:24

(170) Я тоже удерживал мошенников до 40 минут. Точнее, спамеров. Наверное, это их лимит. Первый раз они попадутся на бабку, второй раз уже будут знать, не попадутся.

Почему удивляетесь тому, что ИИ может выполнить задачу, которую человек выполняет с легкостью?

Гораздо интереснее, когда ИИ выполняет задачу, которую человек решает с трудом, или вообще не может решить. Как пример, задача на собеседовании, который я выше писал. Вот это поразительно!

Почему удивляетесь тому, что ИИ может выполнить задачу, которую человек выполняет с легкостью?

Гораздо интереснее, когда ИИ выполняет задачу, которую человек решает с трудом, или вообще не может решить. Как пример, задача на собеседовании, который я выше писал. Вот это поразительно!